Dario Amodei — uno degli uomini che più di chiunque altro ha contribuito a costruire l’intelligenza artificiale così come la conosciamo oggi — ha scritto un saggio che dovrebbe essere letto ben oltre le cerchie tecnologiche. Non perché spieghi come funziona l’AI. Ma perché ammette qualcosa che raramente chi costruisce il futuro è disposto a riconoscere: non sappiamo ancora come governarlo.

La tesi di Amodei è racchiusa in una metafora: la tecnologia contemporanea si trova in una fase adolescenziale. Cresce a una velocità straordinaria, sviluppa capacità sempre più potenti, ma le istituzioni che dovrebbero orientarla e contenerla non riescono a starle dietro. Come un adolescente che ha già la forza di un adulto ma non ancora la saggezza per usarla, l’intelligenza artificiale esiste oggi in uno spazio pericolosamente privo di tutele adeguate.

Vale la pena fermarsi su questa immagine. Perché non è retorica. È una diagnosi politica.

Ogni grande trasformazione tecnologica ha prodotto, prima o poi, un conflitto tra la velocità dell’innovazione e la lentezza delle istituzioni. È accaduto con la rivoluzione industriale, con l’energia nucleare, con internet. In ciascuno di questi casi, il ritardo nella risposta istituzionale ha avuto un costo: incidenti, soprusi, concentrazioni di potere difficili da smantellare in seguito.

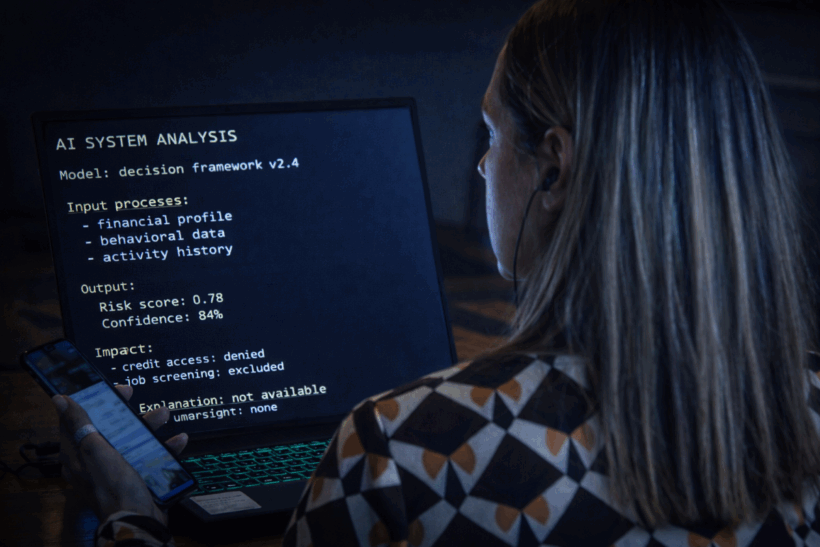

Con l’intelligenza artificiale, questo ritardo rischia di essere più profondo e più rapido allo stesso tempo. L’AI non è una macchina che fabbrica oggetti. È un sistema che produce decisioni, previsioni, raccomandazioni. Decide chi ottiene un prestito, chi viene segnalato come sospetto, chi vede quale contenuto, quale candidato viene selezionato per un colloquio di lavoro. Agisce, in modo sempre più pervasivo, nei gangli della vita quotidiana delle persone.

E lo fa, per lo più, in modo opaco. Senza che i destinatari di quelle decisioni possano capire perché sono state prese, contestarle, chiedere conto a qualcuno.

Nel 2024, l’Unione europea ha adottato il primo grande quadro normativo dedicato all’intelligenza artificiale: il Regolamento UE 2024/1689, noto come AI Act. Non è una legge perfetta. Ma è un tentativo serio di costruire strutture istituzionali capaci di accompagnare, e non subire, la trasformazione in corso.

L’approccio europeo si fonda su una logica di gradazione del rischio. Alcuni usi dell’intelligenza artificiale sono vietati senza eccezioni: la manipolazione subliminale del comportamento umano, la classificazione sociale delle persone da parte delle autorità pubbliche, il riconoscimento biometrico di massa negli spazi pubblici. Altri usi, quelli che toccano la vita concreta delle persone — la selezione del personale, la valutazione degli studenti, le decisioni in campo sanitario — sono soggetti a requisiti stringenti di trasparenza, controllo umano, responsabilità.

È un’architettura che parte da un’idea semplice quanto necessaria: non tutta l’innovazione si equivale, e il grado di scrutinio deve essere proporzionale alla posta in gioco per le persone.

Il problema che Amodei solleva non si risolve con una legge, per quanto ben congegnata. Si tratta di qualcosa di più profondo: la capacità collettiva di ragionare su tecnologie che la maggior parte delle persone — incluse quelle che le governano — non comprende davvero. Le decisioni più importanti sull’intelligenza artificiale vengono prese oggi in ambienti tecnici e aziendali che restano largamente estranei alla deliberazione democratica.

Chi decide quali valori devono essere codificati nei modelli di AI? Chi stabilisce quali bias sono accettabili e quali no? Chi risponde quando un sistema automatizzato sbaglia e produce danno? Queste non sono domande tecniche. Sono domande politiche. E finché restano confinate nei laboratori e nelle sale riunioni delle grandi aziende tecnologiche, la risposta viene data senza che la società abbia voce.

La metafora adolescenziale di Amodei vale anche qui. Un adolescente cresce meglio quando intorno a lui ci sono adulti capaci di accompagnarlo, non di bloccarlo né di abbandonarlo a sé stesso. La governance dell’AI richiede la stessa combinazione: presenza, responsabilità, capacità di ascolto. Non paura del futuro, ma rifiuto della delega incondizionata.

C’è un rischio nell’uso della metafora evolutiva applicata alla tecnologia: quello di farci credere che lo sviluppo segua una traiettoria naturale, e che il nostro compito sia solo quello di adattarci. Non è così. Le tecnologie non crescono da sole. Crescono nella direzione che le scelte umane — economiche, politiche, regolative — decidono di dargli.

L’AI Act europeo è importante non solo per ciò che prescrive, ma per il messaggio implicito che veicola: le società democratiche hanno il diritto e il dovere di porre condizioni allo sviluppo tecnologico. Non in nome della paura, ma in nome di una visione di futuro in cui la tecnologia serva le persone e non le assoggetti.

Che questa visione si affermi o meno dipenderà, nei prossimi anni, da scelte concrete: sulla distribuzione dei benefici dell’automazione, sulla tutela del lavoro, sull’accesso equo alle tecnologie, sulla trasparenza degli algoritmi che già oggi influenzano la vita di milioni di persone.

Amodei chiude il suo saggio con un’affermazione che suona quasi come un appello: la sfida più grande non è la tecnologia in sé, ma la nostra capacità di gestirla con saggezza. Ma la saggezza non è una virtù individuale. È il prodotto di processi collettivi, di istituzioni funzionanti, di spazi pubblici in cui le decisioni possano essere discusse, contestate, cambiate.

L’adolescenza dell’intelligenza artificiale non finirà da sola. E la qualità dell’età adulta che verrà dipende da chi parteciperà alla sua educazione.

La domanda è: la società civile sarà presente a quel tavolo, o lo lasceremo solo ai costruttori?