Una atroce perversione che spinge ad armarsi, reclutare e sacrificare i nostri ragazzi e uccidere i figli degli altri.

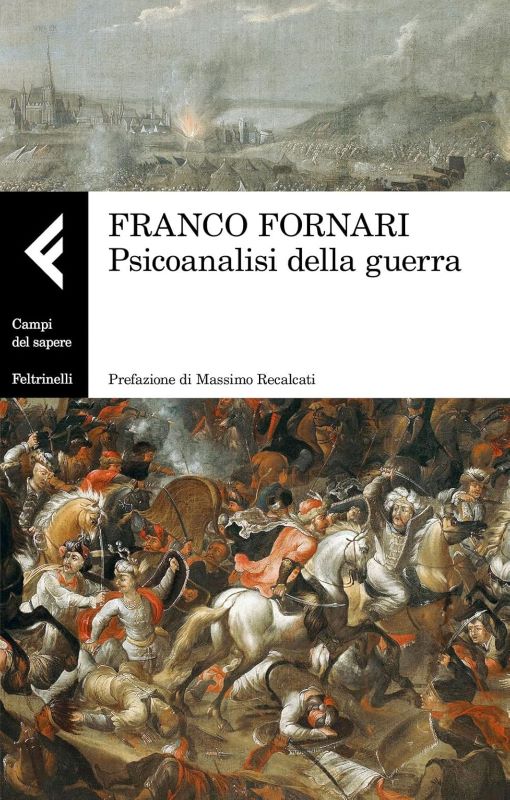

La riflessione sulla guerra come fenomeno umano attraversa la storia del pensiero politico, ma acquista una particolare profondità nella lettura psicoanalitica proposta da Franco Fornari. Nella sua opera Psicoanalisi della guerra (Feltrinelli), Fornari interpreta la guerra non semplicemente come espressione di odio o aggressività, bensì come una forma di “pazzia d’amore”: un’istituzione sociale ritualizzata attraverso la quale le comunità umane tentano di elaborare e contenere le proprie angosce più profonde.

La guerra, in questa prospettiva, diventa un dispositivo simbolico collettivo che consente di trasformare il “terrificante interno” – l’angoscia depressiva, il senso di colpa, la paura della perdita – in un conflitto esterno contro un nemico identificabile. Essa non elimina tali tensioni psichiche, ma le rende gestibili attraverso un linguaggio simbolico fatto di sacrificio, appartenenza e legittimazione morale della violenza.

Questa interpretazione assume una nuova e inquietante attualità nel contesto contemporaneo, caratterizzato dalla crescente integrazione dell’intelligenza artificiale nei sistemi di sicurezza e nella gestione della deterrenza nucleare. Secondo alcune analisi geopolitiche, tra cui quelle di Lucio Caracciolo, l’uso dell’AI nei sistemi strategici rischia di trasformare la deterrenza in una forma di “gestione meccanica della paranoia”. In altre parole, ciò che per decenni è stato un equilibrio fragile fondato su decisioni umane, dubbi, paure e responsabilità morali potrebbe progressivamente essere affidato a sistemi algoritmici progettati per reagire con rapidità e precisione a segnali di minaccia. Il problema non risiede soltanto nell’eventualità tecnica di errori o malfunzionamenti, ma nella trasformazione più profonda della logica stessa della guerra e della deterrenza.

Se la guerra, come sosteneva Fornari, ha storicamente funzionato anche come un rito attraverso cui le società umane elaborano le proprie tensioni psichiche, la sua progressiva automatizzazione rischia di eliminare proprio questa dimensione simbolica. L’intelligenza artificiale non prova paura, non conosce esitazione, non sperimenta il peso della responsabilità morale. Essa opera secondo logiche di calcolo, probabilità e ottimizzazione. Nel momento in cui sistemi di supporto decisionale sempre più sofisticati entrano nei circuiti strategici, il rischio è che la deliberazione politica e morale venga compressa in tempi sempre più brevi, mentre le decisioni operative tendono a essere subordinate alla velocità delle macchine. In tale scenario, la guerra perderebbe il suo carattere di tragica ma umana istituzione sociale per trasformarsi in un processo tecnico altamente automatizzato.

Questa trasformazione genera un paradosso profondo. Nel corso della storia, la guerra è stata una pratica devastante, ma ha comunque mantenuto una dimensione antropologica che implicava responsabilità individuali, conflitti morali e possibilità di esitazione. Anche nei momenti più drammatici della deterrenza nucleare durante la Guerra Fredda, la decisione ultima rimaneva nelle mani di esseri umani consapevoli delle conseguenze potenzialmente catastrofiche delle proprie azioni. La presenza di dubbi, paure e conflitti interiori costituiva paradossalmente uno dei freni più importanti all’uso effettivo delle armi nucleari. L’introduzione dell’AI nei sistemi di comando e controllo rischia di erodere proprio questi freni antropologici. Una macchina non sperimenta l’angoscia della distruzione globale né il senso di colpa per la morte di milioni di persone; essa reagisce a parametri, modelli e segnali. In tal modo, ciò che era un equilibrio psicologico instabile potrebbe diventare un sistema automatico di escalation potenzialmente incontrollabile.

Un ulteriore elemento critico riguarda la compressione del tempo decisionale. I sistemi di intelligenza artificiale sono progettati per elaborare grandi quantità di dati in tempi estremamente ridotti, permettendo ai decisori di reagire quasi istantaneamente a possibili minacce. Tuttavia, nel contesto nucleare, la velocità non è necessariamente un vantaggio. La stabilità strategica della deterrenza è stata storicamente legata anche alla lentezza deliberativa, che lasciava spazio alla verifica delle informazioni, alla comunicazione diplomatica e alla possibilità di correggere interpretazioni errate dei segnali militari. L’automatizzazione dei processi decisionali rischia di ridurre drasticamente questi margini di riflessione, trasformando la deterrenza in una dinamica sempre più rapida e rigida, in cui l’errore o l’interpretazione sbagliata di un segnale potrebbero generare escalation irreversibili.

In questo contesto, anche il significato politico e morale della pace subisce una trasformazione radicale. L’idea tradizionale di “pace giusta”, ottenuta attraverso la vittoria militare e la sconfitta del nemico, appare sempre meno compatibile con un mondo caratterizzato dalla presenza di arsenali nucleari e dall’emergere di sistemi di guerra automatizzati. Una vittoria militare totale tra potenze nucleari equivarrebbe, nella maggior parte degli scenari plausibili, a una distruzione reciproca su scala globale. La logica della “pace giusta” rischia quindi di trasformarsi in quello che potrebbe essere definito un trionfo della morte. In alternativa, diventa necessario pensare a una “pace possibile”, imperfetta e spesso scomoda, basata su compromessi, equilibri instabili e forme di cooperazione minima tra potenze rivali.

In questa prospettiva, la nonviolenza smette di essere soltanto un ideale etico o una posizione morale di carattere utopico. In un mondo in cui la combinazione tra armi nucleari e intelligenza artificiale può ridurre drasticamente il controllo umano sui processi di escalation, la nonviolenza assume un significato pragmatico e strategico. Essa diventa una condizione necessaria per la sopravvivenza collettiva, non tanto come rifiuto assoluto del conflitto, quanto come ricerca sistematica di strumenti politici e diplomatici capaci di prevenire la trasformazione dei conflitti in guerre distruttive.

In questo senso, il rafforzamento del controllo umano nei sistemi decisionali, la trasparenza sugli strumenti tecnologici impiegati nella deterrenza e il rilancio di accordi internazionali di limitazione degli armamenti – come quelli sviluppati nel contesto del Trattato di non proliferazione nucleare – rappresentano elementi fondamentali di una strategia volta a preservare la possibilità stessa della pace.

Riletta alla luce delle trasformazioni tecnologiche contemporanee, l’intuizione di Fornari rivela dunque una sorprendente attualità. Se la guerra è stata storicamente una forma tragica di elaborazione collettiva delle angosce umane, l’automatizzazione della violenza attraverso l’intelligenza artificiale rischia di privare l’umanità perfino di questa mediazione simbolica. Il pericolo non consiste soltanto nell’aumento della potenza distruttiva degli strumenti militari, ma nella progressiva separazione tra decisione e responsabilità, tra azione e coscienza.

In un mondo in cui le macchine possono accelerare i processi di escalation oltre la capacità umana di comprenderli e controllarli, la costruzione di una “pace possibile” non rappresenta più un semplice progetto politico, ma una necessità storica. La sopravvivenza della specie potrebbe dipendere proprio dalla capacità di reintrodurre nella gestione dei conflitti quei limiti, quelle esitazioni e quelle responsabilità che l’automazione tende a cancellare.